AI 기반 옵저버빌리티 운영 안정성 확보와 장애 예방 전략

AI로 진화하는 옵저버빌리티 플랫폼, 현장 실무자가 놓치기 쉬운 운영 리스크와 최적화 포인트를 구체적으로 짚어드립니다.

운영 현장, AI 옵저버빌리티 도입에서 마주치는 실질적 문제

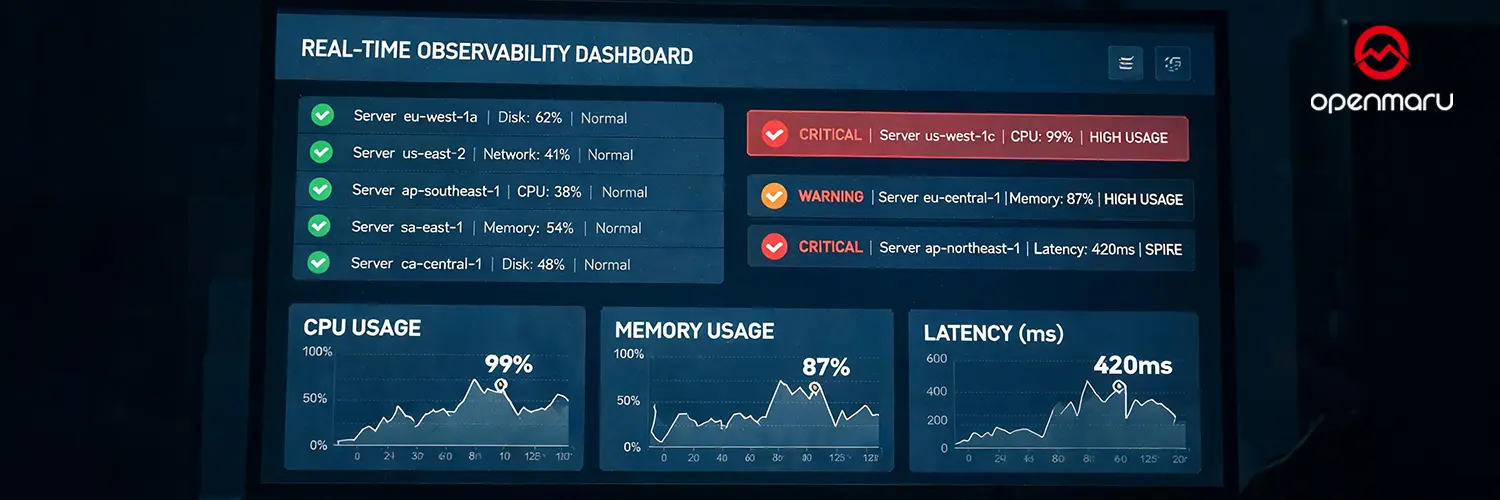

최근 운영 환경에서 AI 기반 옵저버빌리티 플랫폼 도입은 단순한 트렌드가 아닌 필수 요소로 자리잡고 있습니다. 하지만 실제 현장에서는 예기치 못한 트러블슈팅 지연, 데이터 폭증으로 인한 성능 저하, MTTR(Mean Time To Resolution) 단축 압박, 그리고 복잡한 규제 환경이 운영팀에 큰 부담으로 작용합니다.

예를 들어, 컨테이너 기반 마이크로서비스에서 장애가 발생했을 때, 로그·메트릭·트레이스 데이터가 분산되어 즉각적인 원인 분석이 어려워집니다. 기존 모니터링 시스템만으로는 장애 원인 파악과 복구까지 시간이 오래 걸리며, SRE 인력 부족과 반복적인 장애 상황에서 운영의 연속성이 크게 위협받습니다.

특히 망분리, 데이터 주권, 폐쇄망 환경 등 국내 특수 규제 환경에서는 글로벌 벤더의 AI 기능을 도입했다가 실제 서비스 장애 시 복원력 확보에 실패하는 사례가 적지 않습니다.

오픈마루 백서 구독하기🔔

새로운 백서 소식을 가장 먼저 만나보세요!

오픈마루가 전하는 클라우드 네이티브 인사이트와 최신 백서 소식을 가장 빠르게 받아보실 수 있습니다.

구독해 주시면 더 좋은 콘텐츠로 보답하겠습니다.🙏

AI Observability의 성능·안정성 관점 주요 이슈

AI Observability 플랫폼이 기존 모니터링과 결정적으로 구분되는 지점은 트러블슈팅의 신속한 종결, 즉 Time-to-Resolution 단축에 있습니다.

AI·자동화 도입으로 기대하는 ‘알람 노이즈 감소’나 ‘자동 복구’ 효과는 실제 운영에서는 데이터 수집량과 분석의 깊이, 그리고 인과관계 추론(Causal AI) 등 다양한 요인에 따라 결과가 달라집니다. 이 과정에서 운영 안정성을 위협하는 대표적인 이슈는 다음과 같습니다.

- 첫째, 텔레메트리 데이터 폭증으로 AI 모델 학습 부하가 심화되어 인프라 리소스가 소진되는 현상.

- 둘째, Agentic AIOps가 도입되었음에도 불구하고, MCP(Model Context Protocol) 연동 부재나 BYO LLM(Bring Your Own LLM) 미지원으로 인해 기업 데이터 주권을 확보하지 못하거나, 폐쇄망 환경에서 기능 제한이 발생하는 경우입니다.

- 셋째, 다수의 벤더 솔루션을 연동해 운영할 때 ‘통합 콘솔 부재’로 장애 진단 및 조치가 느려지는 점도 심각한 문제로 부상합니다.

결국 운영 현장에서는 AI 옵저버빌리티 플랫폼의 기술적 진화가 곧바로 운영 효율화로 이어지지 않고, 오히려 새로운 장애 요인이나 관리 포인트를 추가할 수 있기에 충분한 사전 점검과 체계적인 성능 검증이 필수적입니다.

장애 발생 시 AI 옵저버빌리티 기반 문제 진단·해결 사례

실제 클라우드 네이티브 환경에서 마이크로서비스 장애가 발생한 사례를 살펴보면, AI 옵저버빌리티 플랫폼의 도입이 MTTR 단축에 어떻게 기여하는지 명확히 드러납니다.

한 글로벌 서비스 기업 사례를 보면, 전통적 모니터링 시스템으로는 장애 발생 후 로그, 메트릭, 트레이스 데이터를 각기 따로 수집해 원인 분석에 2~3시간 이상 소요되었습니다. 반면 AI 옵저버빌리티 플랫폼 도입 이후에는, Causal AI 기반 인과 추론과 Agentic 워크플로가 로그·메트릭·트레이스를 통합 분석하여 약 30분 만에 장애 원인을 특정하고, 자동 복구 시나리오를 실행할 수 있었습니다.

특히 BYO LLM을 통해 자체 보유 데이터를 활용한 자연어 질의(NLQ)가 가능해지면서, SRE 인력이 부족한 상황에서도 빠르게 트러블슈팅을 완료할 수 있었습니다.

이 과정에서 MCP 프로토콜을 통한 데이터 연결, 폐쇄망 환경에서의 Self-hosted 모니터링 등도 안정적인 운영을 뒷받침했습니다. 그러나 초기에는 AI 모델 튜닝이 미흡해 불필요한 알람이 빈번하게 발생했고, 운영팀이 신규 자동화 정책에 익숙해지는 데 시간이 걸렸다는 점도 실무 교훈으로 남았습니다.

운영 최적화를 위한 실무 체크리스트와 성능 관리 포인트

운영 안정성 확보와 장애 예방을 위해서는 AI Observability 플랫폼의 특성을 반영한 아래와 같은 실무 점검이 필수입니다. 먼저, Time-to-Resolution(문제 감지부터 복구까지 소요되는 시간)을 핵심 지표로 모니터링 구조를 설계해야 합니다.

단순한 데이터 수집 폭이 아니라, 각 장애 유형별로 실제 원인 분석과 조치까지 걸린 시간을 지속적으로 측정하고, 이를 기반으로 자동화 정책을 주기적으로 개선해야 합니다. 다음으로, MCP와 BYO LLM 지원 여부를 점검하여 데이터 주권 확보와 폐쇄망 환경 대응 가능성을 검증하는 것이 중요합니다.

글로벌 벤더 솔루션이라도 MCP 미지원, LLM 고정형 구조라면 국내 규제 환경에서 운영 리스크가 커질 수 있으므로 반드시 사전 검증이 필요합니다.

또한, 통합 콘솔/SKU 연동 현황, 클라우드별 AI 기능 가용성(AWS, Azure, GCP 등 리전별 차이)도 장애 대응 속도에 직접적인 영향을 미칩니다. 현장에서는 운영팀이 아래와 같은 체크리스트를 반드시 점검해야 합니다.

검해야 합니다.

각 서비스별 Time-to-Resolution 현황 주간/월간 집계 및 원인별 이슈 분석

Causal AI 기반 인과 추론 기능의 실제 활용률과 오탐/누락 케이스 점검

BYO LLM, MCP, Self-hosted 모니터링 지원 여부 및 폐쇄망 대응 시나리오 사전 검증

통합 콘솔(알림, RCA, 자동화 정책 등)에서 장애 대응 워크플로의 단일화 수준 진단

자동화 정책 변경 시 실제 장애 복구율(Closed Loop Automation 실효성) 모니터링

벤더별/리전별 AI 기능 차이에 따른 장애 대응 속도 및 운영 리스크 사전 도출

이러한 점검을 통해 운영팀은 AI 옵저버빌리티 플랫폼의 도입 효과를 극대화할 수 있습니다.

안정적 운영을 위한 핵심 액션 아이템과 제언

AI 기반 옵저버빌리티 플랫폼이 제공하는 자동화·인과 추론·통합 콘솔 등 최신 기능이 운영 환경에 즉시 안정성을 보장하지는 않습니다. 운영팀은 도입 전후 Time-to-Resolution, Agentic AIOps 활용도, MCP/BYO LLM 지원 등 7대 핵심 체크리스트를 중심으로 지속적인 성능 검증 체계를 갖추어야 합니다.

특히, 장애 발생 시 트러블슈팅 프로세스의 단일화와 폐쇄망, 데이터 주권 등 규제 환경에 대한 대응력을 반드시 사전 점검해야 안정적 운영이 가능합니다.

마지막으로, 모든 AI 옵저버빌리티 기능은 실제 운영팀의 대응 속도와 복구율 개선에 기여해야만 그 가치가 실현됩니다. 현장 중심의 운영 데이터 분석, 자동화 정책의 주기적 검증, 장애 예방을 위한 사전 시나리오 구축을 통해 안정성과 성능 최적화를 동시에 달성하시기 바랍니다.

운영팀의 역량과 도구의 진화가 함께 이루어질 때, AI 시대의 IT 인프라 운영은 비로소 높은 신뢰성과 복원력을 확보할 수 있습니다.

참고:

이 포스트는 AI 옵저버빌리티 플랫폼의 운영 안정성·성능 최적화 관점에서 실무자에게 실질적인 점검 포인트와 문제 해결 방안을 제공합니다. 운영 환경에 최적화된 체크리스트와 사례 적용으로 장애 예방과 신속한 복구 체계를 구축하시길 권장합니다.